شرکت دانش بنیان مایسا (Maisa) تونسته یه فریمورک نرمافزاری جدید به اسم پردازنده پردازش دانش (KPU یا Knowledge Processing Unit) طراحی کنه که باعث میشه مدلهای زبانی مثل GPT-4 یا Claude به قابلیتهای استدلالی پیشرفته دست پیدا کنن. توی آزمایشهای اولیه هم، نتایج فوقالعاده بوده.

KPU طوری طراحی شده که با انواع مختلف مدلهای زبانی به صورت ماژولار کار میکنه. دیوید ویالون، مدیرعامل مایسا، توضیح میده: “فکر کنین مدلها مثل پردازنده هستن بعد (CPU) و KPU میشه پردازنده گرافیکی (GPU) واسه مدیریت و پردازش دانش.

این معماری سه تا بخش اصلی داره: موتور استدلال که توسط یه مدل زبانی بزرگ (LLM) مثل GPT-4 تامین میشه، مراحلی که برای انجام یه وظیفه لازمه رو مشخص میکنه، همینطور ابزارهای ضروری رو. قسمت بعدی موتور اجراییه که دستورات برنامهریزنده رو پیاده میکنه و در مورد اون روند فیدبک میفرسته.

پنجره زمینه مجازی هم به بهترین نحو ممکن از قابلیتهای مدل زبانی استفاده میکنه، اینکار رو طوری انجام میده که هوشمندانه دادهها رو مدیریت و فقط اطلاعاتی که ضروری هست برای حل کردن مسئلهرو در اختیار اون قرار میده.

این تبادل اطلاعات به شکل هدفمند باعث میشه تا KPU بتونه متون طولانیتر و کارهای پیچیدهتر رو بدون نیاز به تکنیکهایی مثل قطعهقطعه کردن (chunking) یا تعبیه (embedding) انجام بده (تو تکنیک قطعهقطعه کردن متن رو به بخشهای کوچیکتر تقسیم میکنن؛ تو تکنیک تعبیه هم کلمات به عدد تبدیل میشن).

پنجره زمینه مجازی یه کار دیگه هم انجام میده، از منابع خارجی مثل ویکیپدیا، یا فایلهای قابل دانلود اطلاعاتی رو به صورت خودکار میگیره تا عملکرد موتور استدلال رو ارتقا بده.

مایسا ادعا میکنه که با تفکیک استنتاج (inference) از پردازش داده در KPU، ضعفهای رایج مدلهای بزرگ زبانی (LLM) که فعلا داریم، مثل هالوسینیشن (hallucinations)، ظرفیت کم برای پردازش زمینه (context)، اطلاعات قدیمی و عدم سازگاری با سیستمهای جانبی رو رفع کرده. علاوه بر اینها، این فریمورک طوری طراحی شده که برای مسائل منطقی پیچیده و چندمرحلهای، به صرفهتر و موثرتر از استفاده مستقیم از مدل باشه.

پردازنده پردازش دانش (KPU) باعث ارتقای GPT-4 میشود

در تستهای اولیه، مایسا با این پردازنده (KPU) تونسته قابلیتهای استدلالی GPT-4 رو که متعلق به OpenAI هست بهینهسازی کنه. ویالون میگه وقتی KPU با مدل زبانی Anthropic به اسم Claude ۳ Opus ترکیب شد، توی نتایج تستهای استانداردی که گرفته شده، پیشرفتها «خیلی چشمگیر» بوده. KPU هرچی با یه مدل زبانی کارآمدتر کار کنه، احتمال اینکه عملکرد بهتری داشته باشه بیشتر میشه.

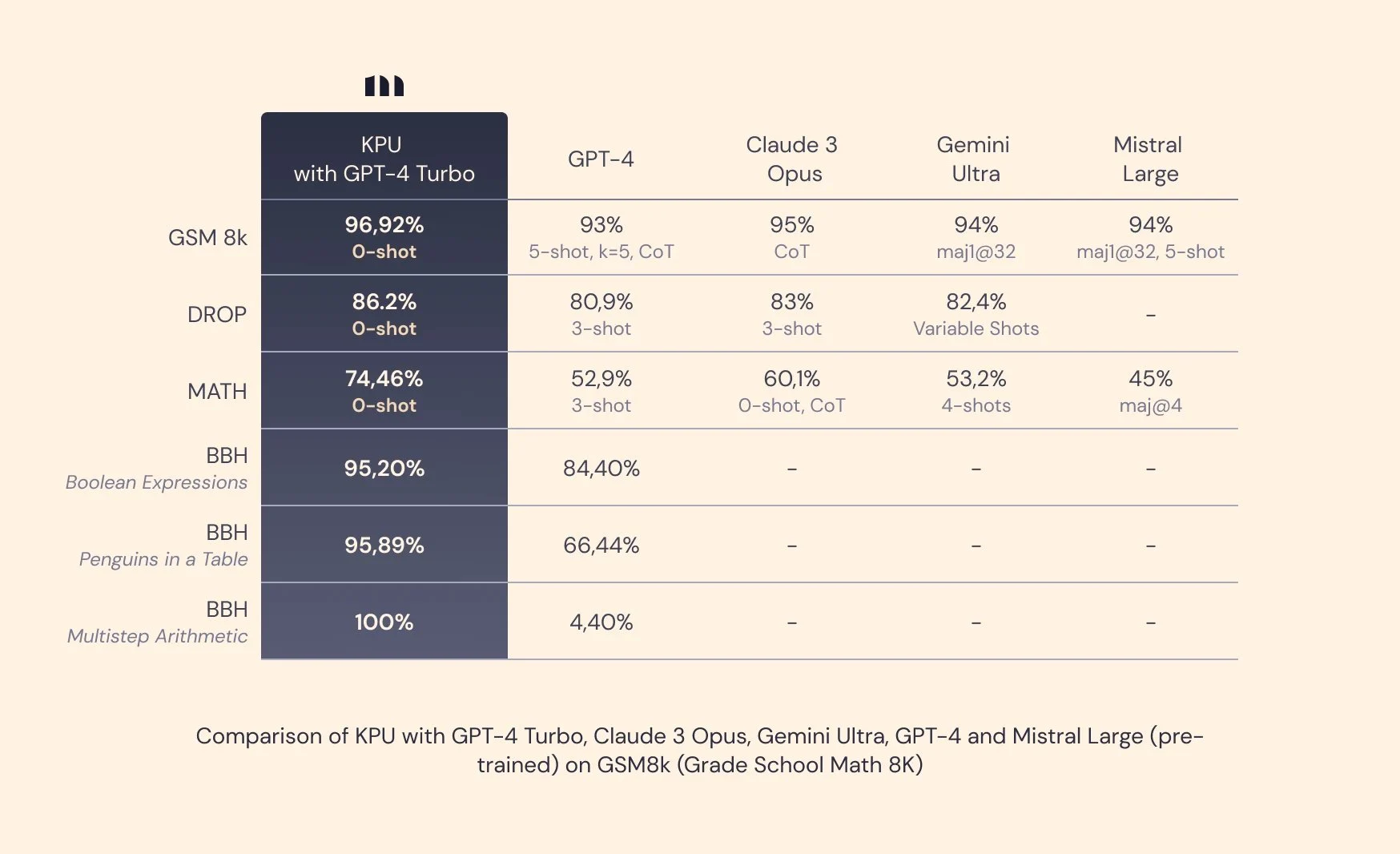

روی تستهای استدلالی سخت مثل GSM8k برای کارهای ریاضی که به صورت متنی مطرح میشن، روی مجموعه داده MATH مخصوص مسابقات ریاضی، آزمون خواندن و درک مطلب به اسم DROP، و بخشهایی از Big-Bench Hard، وقتی GPT-4 رو با KPU همراهی کنن، در حالت صفر (zero-shot) به صدر جدول میرسن. منظور از حالت صفر اینه که هیچ دستورالعمل یا مثال تکمیلی به اون داده نشده و از مدلهای زبانی پیشرو عملکرد بهتری نشون داده.

مایسا پتانسیل این تکنولوژی رو توی دستیارهای دیجیتال متخصص در یک حوزه، اتوماسیون کردن فرایندهای پیچیده، تحلیل حجم بسیار زیادی از دادهها و برنامههای یادگیری هوشمند میبینه. این شرکت میگه ساختار ماژولار KPU باعث میشه راحت بتونیم استفاده و گسترشش بدیم.

با اینکه الان KPU توی فاز آزمایشی قرار داره، هر کسی که علاقهمنده میتونه بره توی صف انتظار تا از نسخه بتا استفاده کنه. مایسا هنوز تاریخی برای اینکه بگیم کی برای استفاده در بازار آماده میشه اعلام نکرده، ولی قراره سیستم هم از طریق (API) و هم به عنوان یه رابط کاربری وب ارائه بشه.

اگه KPU بتونه وعدههایی رو که داده عملی کنه، اونوقت به میزان قابل توجهی روی توانایی هوش مصنوعی توی فکر کردن و حل مستقل مسائل تاثیر گذاشته. اما هنوز مشخص نیست که آیا تکنولوژی مایسا خاص و منحصر بهفرده، یا همین الان شرکتهای بزرگ حوزه هوش مصنوعی دارن روی کارهای مشابه کار میکنن (مثل Cappy یا Quiet Star یا *Q).